C’è un futuro, a quanto pare, in cui i pensieri non sono più solo effimere immagini nella nostra mente, ma possono diventare video HQ. E sembra un futuro sempre più vicino alla realtà. Un gruppo di abili ricercatori ha appena scoperchiato il vaso di Pandora nel campo della neuroscienza. Ad aiutarlo, una buona dose di AI.

Il cervello “proiettore”

Jiaxin Qing, Zijiao Chen e Juan Helen Zhou, di National University di Singapore e Chinese University di Hong Kong, hanno presentato un lavoro di ricerca piuttosto interessante. Il team ha combinato i dati ottenuti da risonanze magnetiche funzionali (fMRI) con l’intelligenza artificiale generativa Stable Diffusion per creare MinD-Video, un modello che può generare video HQ direttamente dalle letture del cervello.

Una roba da fantascienza, direte: e invece no, tutto rigorosamente documentato su arXiv, e questo è il link.

Come funziona esattamente MinD-Video?

MinD-Video non è un semplice generatore di video, ma un’intero sistema studiato per far dialogare la decodifica delle immagini fatta da una AI e quella fatta da un cervello. Ma come si addestra un sistema del genere?

I ricercatori hanno usato un set di dati pubblico, contenente video e relative letture fMRI di soggetti che li hanno guardati. E a quanto pare il lavoro ha funzionato egregiamente.

Vedere i pensieri, ci siamo arrivati

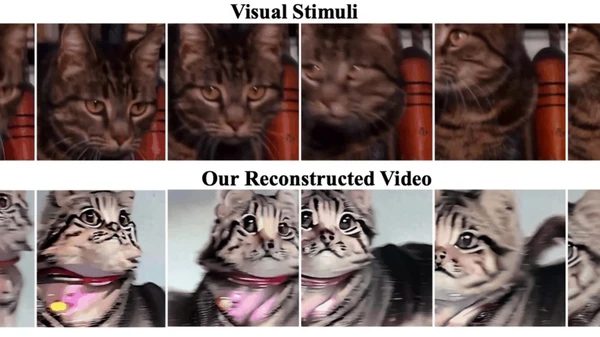

I video pubblicati dagli scienziati mostrano risultati davvero affascinanti. Prendiamo ad esempio un video originale con cavalli in un campo. MinD-Video lo ha “ricostruito” creando una versione più vibrante dei cavalli. In un altro caso, una macchina percorre una zona boscosa e il video ricostruito mostra un viaggio in prima persona lungo una strada tortuosa.

Secondo i ricercatori, i video ricostruiti sono di “alta qualità”, con movimenti e dinamiche di scena ben definite. E la precisione? L’85%, un miglioramento significativo rispetto ai precedenti tentativi.

Lettura della mente e video HQ, che prospettive ci sono?

“Il futuro è brillante, e le potenziali applicazioni sono immense. Dalla neuroscienza alle interfacce cervello-computer, crediamo che il nostro lavoro potrà avere un impatto importante” hanno dichiarato gli autori. E le scoperte non si limitano a questo: il loro lavoro ha evidenziato il ruolo dominante della corteccia visiva nella percezione visiva, e la capacità del loro modello di apprendere informazioni sempre più sofisticate durante la formazione.

Il modello Stable Diffusion utilizzato in questa nuova ricerca rende la visualizzazione più precisa. “Un vantaggio chiave del nostro modello rispetto ad altri modelli generativi, come le GAN, è la capacità di produrre video di qualità superiore. Sfrutta le rappresentazioni apprese dall’encoder fMRI e usa il suo esclusivo processo di diffusione per generare video HQ che si allineano meglio con le attività neurali originali”, hanno spiegato i ricercatori.

Insomma, sembra che siamo davvero entrati nell’era della lettura della mente attraverso l’intelligenza artificiale. Un campo aperto a mille possibilità, dove il limite sembra essere solo l’immaginazione.