La scorsa settimana abbiamo affrontato il problema del panico indotto dai media sull’intelligenza artificiale. Un modo come un altro, vi dicevo, per negare un sano dibattito sulle opportunità e sui rischi di questa tecnologia che può cambiare completamente la nostra società. C’è ovviamente anche il rovescio della medaglia: un nutritissimo gruppo di scienziati che non si preoccupa minimamente dei possibili pericoli. A torto o a ragione?

Perchè c’è chi chiude un occhio

“Avete mai pensato che l’intelligenza artificiale potrebbe causare la fine dell’umanità?”. In una recente conferenza stampa alla Casa Bianca, la portavoce Karine Jean-Pierre ha riso di fronte a questa domanda. Peccato che la risposta sia un serio “no”. Nonostante pionieri dell’AI come Alan Turing avessero già avvertito dei rischi che le “macchine prendessero il controllo”, molti ricercatori attuali sembrano non preoccuparsene affatto. Eppure, l’IA sta progredendo a ritmi incredibili. Allora, perché non ne discutono di più?

David Krueger, professore al Dipartimento di Ingegneria dell’Università di Cambridge, sostiene che le ragioni siano soprattutto culturali e storiche. Dopo varie fasi in cui su queste tecnologie sono state poste aspettative eccessive ed idealistiche (utopia o distopia), i ricercatori si sono decisi a passare alla pratica. Per questo, si sono concentrati su ambiti specifici, come la guida autonoma, smettendo di porsi domande sulle implicazioni a lungo termine.

Hanno fatto bene o male? E se i rischi fossero reali?

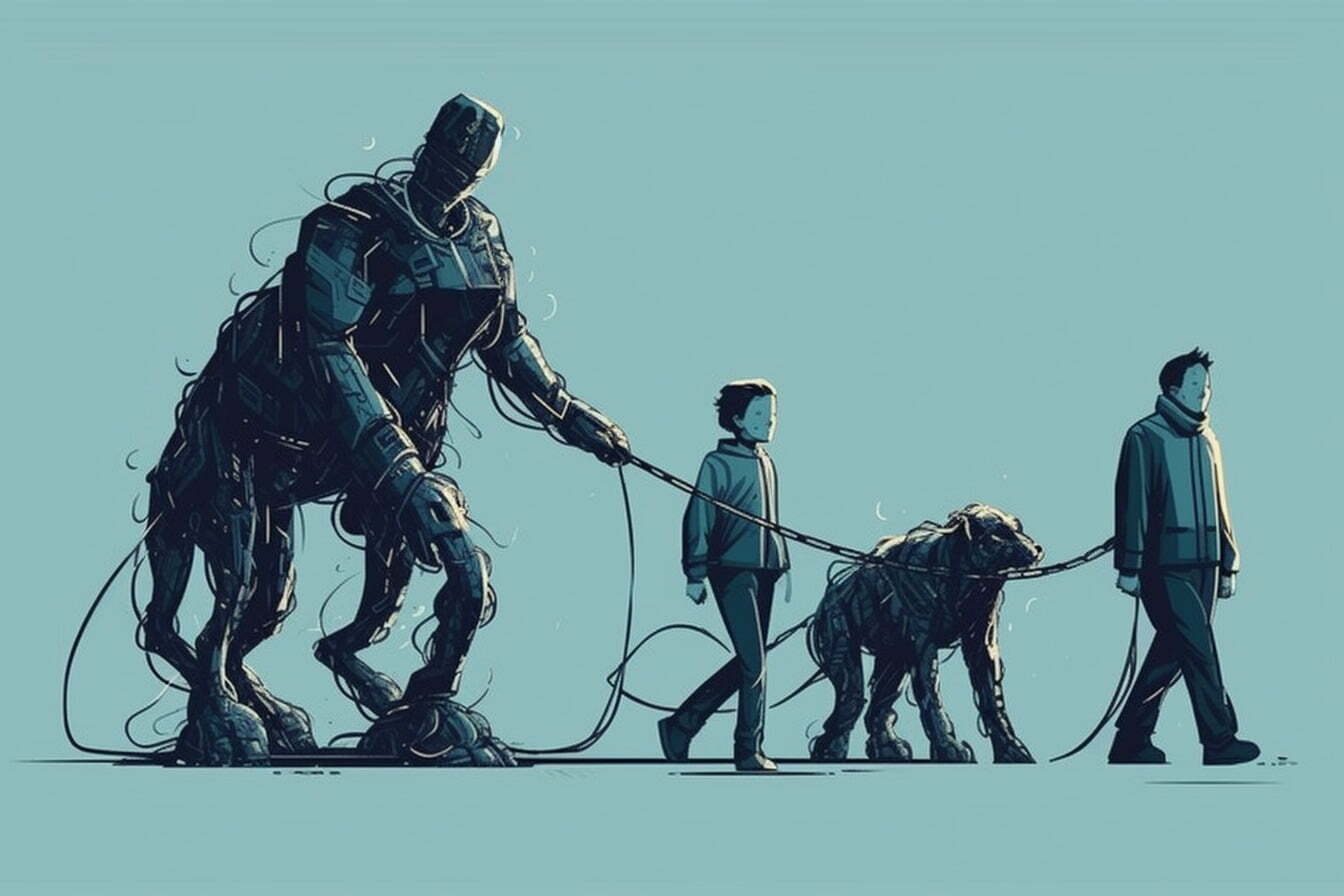

Un argomento di base dei “preoccupati” (una categoria molto diversa dai “catastrofisti”, attenzione) è l’analogia tra l’AI e gli esseri umani. Così come l’uomo ha estinto altre specie per competere per le risorse, l’intelligenza artificiale potrebbe fare lo stesso con noi. Potrebbe sostituirci, in altri termini. Economicamente e politicamente. Fisicamente.

Sono temi che suonano enormi, quasi fantascientifici. Ed infatti, spesso i rischi dell’AI vengono ignorati proprio perché ritenuti “non scientifici”. Tuttavia, ciò non giustifica la mancanza di attenzione. Al contrario, dovremmo affrontare questi problemi come facciamo con altre questioni sociali complesse. E qui entra in gioco un elemento cruciale: i finanziamenti. La maggior parte dei ricercatori sull’intelligenza artificiale riceve finanziamenti da giganti tecnologici, creando possibili conflitti di interesse che possono influenzare il modo in cui gli esperti affrontano i problemi legati all’IA, portando a una negazione dei rischi piuttosto che a una valutazione obiettiva delle possibili minacce.

Per questo, invece di “inclinarsi” su uno dei due poli, nell’esercizio che piace di più a chi guida finanza e media (divide et impera), l’opinione pubblica dovrebbe guardare avanti, anzi dentro. Dentro le cose, pretendendo che il tema si approfondisca.

È ora di fare sul serio

I rischi esistenziali dell’intelligenza artificiale potrebbero essere più speculativi che reali rispetto a questioni urgenti come i pregiudizi e le fake news, ma la soluzione di base è la stessa: la regolamentazione. È ora di avviare un robusto dibattito pubblico, e di affrontare le questioni etiche legate all’AI. Tutto il resto è noia, anzi, ottusità.

Perchè lo sappiamo: non possiamo permetterci di ignorare i potenziali rischi dell’intelligenza artificiale per l’umanità. È fondamentale un dibattito pubblico aperto e onesto, che tenga conto dei conflitti di interesse e delle responsabilità etiche. Solo così potremo capire se le risate di una portavoce alla Casa Bianca sono davvero appropriate o, al contrario, un segno di pericolosa (questa si) incoscienza collettiva.